Command Palette

Search for a command to run...

Qwen3 技术报告

Qwen3 技术报告

Owen Team

摘要

在本研究中,我们正式推出 Qwen3,这是 Qwen 模型系列的最新版本。Qwen3 包含一系列大语言模型(LLMs),旨在全面提升模型性能、推理效率及多语言处理能力。该系列涵盖稠密架构(dense)与混合专家架构(Mixture-of-Expert, MoE)两种模型类型,参数量规模覆盖 0.6 亿至 2350 亿。Qwen3 的一项核心创新在于,将“思考模式”(thinking mode,适用于复杂多步推理任务)与“非思考模式”(non-thinking mode,适用于快速、基于上下文的响应)整合至统一框架之中。这一设计消除了在不同专用模型间切换的需求(例如,在针对对话优化的模型如 GPT-4o 与专用推理模型如 QwQ-32B 之间切换),并支持根据用户查询或对话模板动态切换推理模式。此外,Qwen3 引入了“思考预算机制”(thinking budget mechanism),允许用户在推理过程中自适应地分配计算资源,从而依据任务复杂度在延迟与性能之间实现动态平衡。同时,通过有效利用旗舰模型的知识蒸馏与迁移能力,我们显著降低了构建小规模模型所需的计算资源,同时确保其性能在同类模型中保持高度竞争力。实证评估结果表明,Qwen3 在代码生成、数学推理、Agent 任务等多个基准测试(benchmark)中均取得了最先进(state-of-the-art)的性能表现。

一句话总结

Qwen 团队推出了 Qwen3,这是一个参数规模从 0.6 到 2350 亿的稠密模型和混合专家模型系列,它通过思考预算机制将思考模式和非思考模式整合到统一框架中,消除了模型切换,并在代码生成、数学推理和智能体任务上实现了最先进结果。

核心贡献

- 我们推出了 Qwen3,在统一框架内整合了用于复杂推理的思考模式和用于快速响应的非思考模式。该方法允许根据用户查询动态切换模式,消除了为不同类型任务部署单独模型的必要性。

- 这项工作引入了思考预算机制,使用户能够在推理期间自适应地分配计算资源,以平衡延迟和性能。实证评估表明,增加思考 token 的预算始终能提高模型在各种任务中的性能。

- 我们发布了一系列模型,包含稠密和混合专家架构,参数规模从 0.6 到 2350 亿。利用旗舰模型的知识减少了构建小规模模型所需的计算资源,同时确保了其极具竞争力的性能。

引言

通用人工智能的追求依赖于大型基础模型,但大多数领先能力仍然是专有的,或者需要在推理和聊天任务之间切换专用模型。这种碎片化造成了部署效率低下,并限制了寻求强大开源替代方案的开发者的访问。为了解决这些挑战,作者提出了 Qwen3,这是一个在单一架构内整合思考和非思考模式的统一模型家族。他们利用思考预算机制自适应地平衡延迟和性能,同时利用强到弱蒸馏以保持小模型的高能力。此外,团队将多语言支持扩展到 119 种语言,并在开放许可下发布所有模型,以促进更广泛的研究和开发。

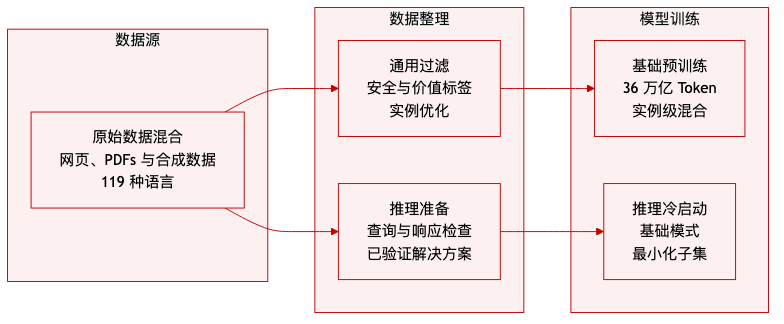

数据集

- 预训练数据构成:作者利用了一个包含 36 万亿 token 的语料库,涵盖 119 种语言和方言。内容包括代码、STEM、推理任务、书籍、多语言文本和合成数据。

- 数据扩展与来源:他们使用 Qwen2.5-VL 从类 PDF 文档中提取文本进行识别,并使用 Qwen2.5 优化输出。此外,他们使用 Qwen2.5、Qwen2.5-Math 和 Qwen2.5-Coder 合成了以教科书和代码片段等格式组织的万亿级 token。

- 标注与过滤:一个多语言数据标注系统对超过 30 万亿 token 进行了标注,维度包括教育价值、领域、学科和安全。团队通过代理模型的消融实验在实例级别优化数据混合,而不是在领域级别。

- 长思维链冷启动数据集:对于推理训练,他们策划了一套全面的数学、代码、逻辑推理和 STEM 问题集。每个问题都配有经过验证的参考答案或基于代码的测试用例。

- 冷启动过滤规则:构建过程涉及查询过滤,以使用 Qwen2.5-72B-Instruct 移除不可验证的项目或无需思维链推理即可解决的问题。响应过滤使用 QwQ-32B 生成候选项,并应用严格标准以移除错误、重复、猜测或风格不一致。

- 训练策略:预训练数据支持基础模型开发,并进行实例级别混合优化。冷启动阶段使用最小化的样本子集来灌输基础推理模式,同时为后续的强化学习保留灵活性。

方法

Qwen3 系列包含六个稠密模型和两个混合专家 (MoE) 模型。稠密变体参数范围从 0.6B 到 32B,而旗舰 MoE 模型 Qwen3-235B-A22B 使用 235B 总参数,每 token 激活 22B。该架构在 Qwen2.5 的基础上构建,结合了分组查询注意力 (GQA)、SwiGLU 激活和旋转位置嵌入 (RoPE)。一个关键的修改涉及移除 QKV 偏置并在注意力机制中引入 QK 归一化,以确保训练稳定性。对于 MoE 变体,设计包含 128 个总专家,每 token 激活 8 个,并不包含共享专家,而是依赖全局批次负载均衡损失来鼓励专业化。

预训练遵循三阶段课程。初始通用阶段利用超过 30 万亿 token,序列长度为 4,096,以在 119 种语言中建立基础语言能力。随后的推理阶段优化语料库,使用高质量的 STEM、代码和合成数据以增强逻辑能力。最后,长上下文阶段使用 ABF 进行 RoPE 频率缩放、YARN 和双块注意力 (Dual Chunk Attention) 等技术将序列长度扩展到 32,768 token,以支持长视界推理。

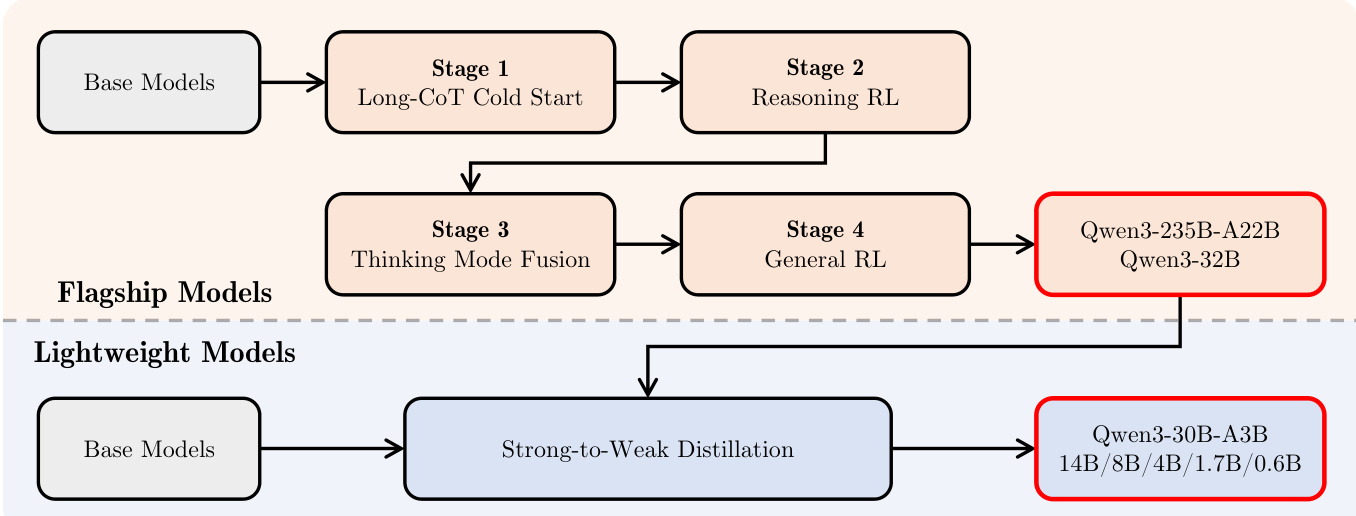

后训练策略旨在实现思考控制和高效知识迁移。如下面的框架图所示:

旗舰模型经过复杂的四阶段流程。阶段 1 和 2 通过长思维链冷启动和推理强化学习专注于开发推理能力。阶段 3,思考模式融合,通过持续监督微调将非思考功能整合到推理模型中。该阶段引入了带有 /think 和 /no_think 标志的特定聊天模板,允许用户动态控制推理过程。此外,这种融合实现了涌现的预算控制,模型可以在达到 token 阈值时停止思考。阶段 4 应用通用强化学习,通过多层面奖励系统扩展指令遵循、格式遵守和智能体交互等方面的能力。

对于轻量级模型,作者利用强到弱蒸馏来简化开发。这种方法避免了为较小模型进行计算成本高昂的四阶段训练。相反,它在离线策略阶段利用旗舰模型作为教师来迁移推理技能和模式切换能力。随后是在线策略阶段,学生模型将其 logit 与教师对齐以最小化 KL 散度,从而以显著减少的 GPU 时间实现高性能。

实验

实验设置评估了 Qwen3 基础模型和指令微调模型在推理、代码和多语言任务等多样化基准测试中的表现,与强大的开源和闭源基线在思考和非思考模式下进行了对比。结果表明,Qwen3 基础模型通过以更少的激活参数胜过更大的前身,实现了最先进的效率,而后训练评估确认旗舰模型在推理能力上与闭源系统不相上下。此外,该研究验证了强到弱蒸馏对轻量级模型的有效性,并指出虽然通用强化学习增强了通用性,但在特定复杂任务性能上可能涉及权衡。

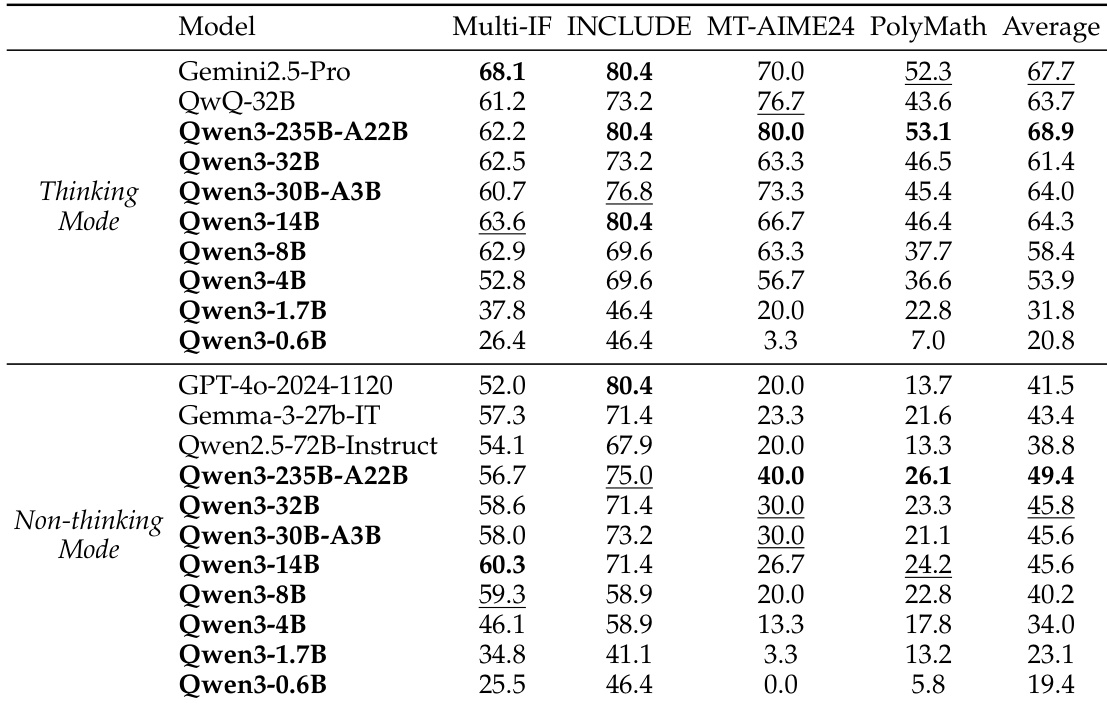

下表评估了 Qwen3 模型与强大基线在多语言和数学推理能力方面的表现。旗舰模型 Qwen3-235B-A22B 在思考和非思考模式下均取得了最高的平均分数。启用思考模式与不启用思考的配置相比,始终提高了所有模型规模的性能。Qwen3-235B-A22B 在两种模式下均以最高平均分数领先评估。激活思考模式显著提升了数学和多语言基准测试的性能。Qwen3 模型在所有方面均优于前几代和竞争的开源模型。

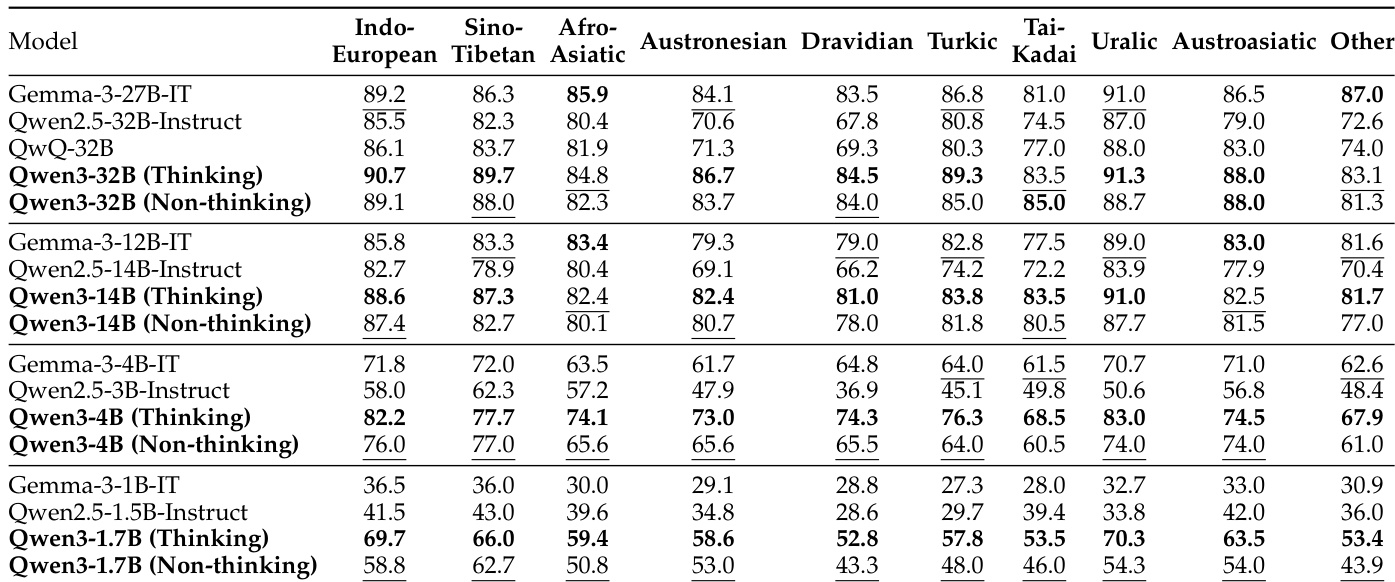

作者展示了 Qwen3 模型在不同语系上的评估结果。数据显示,Qwen3 模型,特别是在思考模式下,与 Qwen2.5 和 Gemma-3 基线相比始终取得更优越的性能。思考模式下的 Qwen3-32B 在几乎所有语系中均领先性能。Qwen3 模型在性能上优于规模相似或更大的 Qwen2.5 和 Gemma-3 基线。思考模式变体的得分通常高于非思考版本。

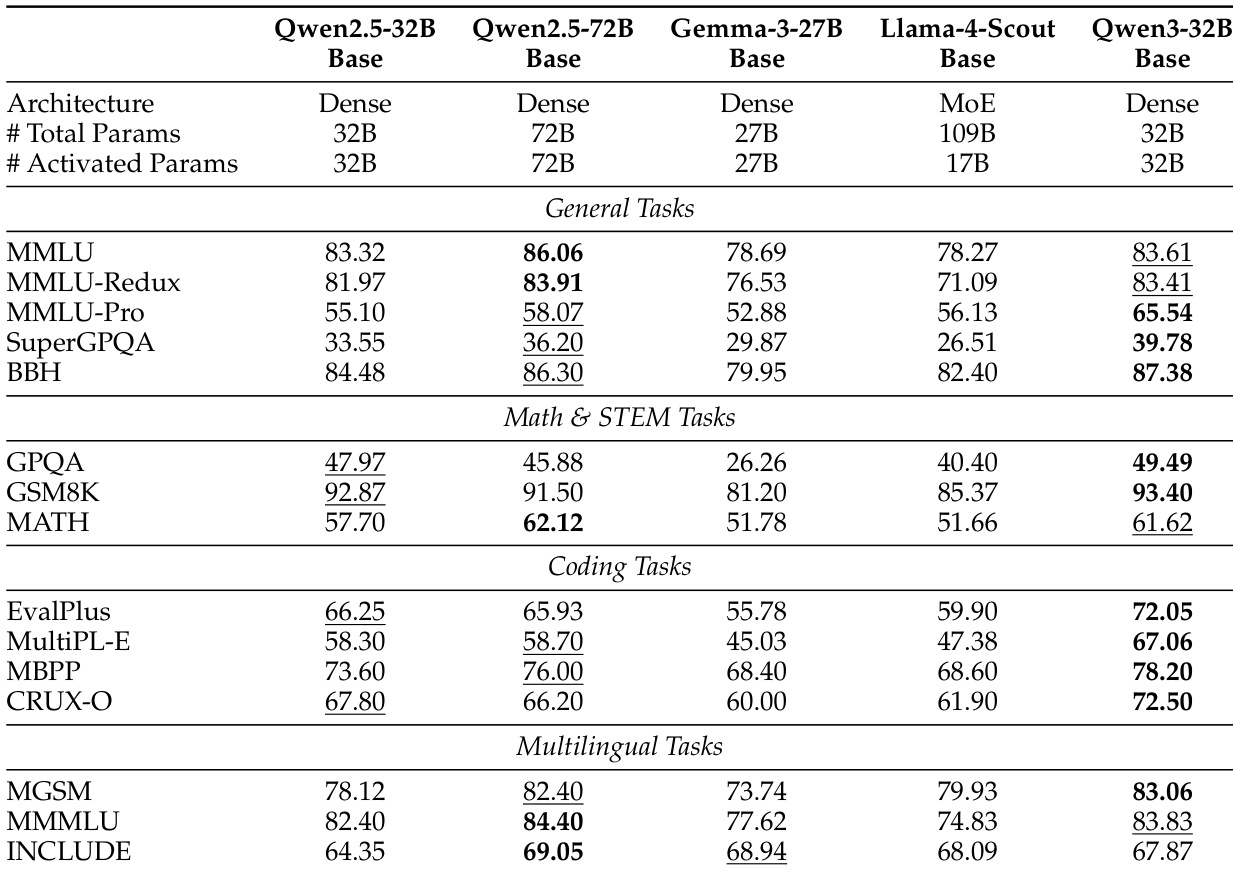

作者将 Qwen3-32B 基础模型与之前的 Qwen2.5 版本以及其他领先的开源模型(包括 Gemma-3 和 Llama-4-Scout)进行了比较。结果表明,Qwen3-32B 基础模型在通用、数学、代码和多语言任务上均取得了优越的性能,经常超越更大的模型如 Qwen2.5-72B 基础模型。Qwen3-32B 基础模型在大多数基准测试中优于更大的 Qwen2.5-72B 基础模型,尽管其参数更少。该模型在代码和 STEM 任务中表现出卓越的能力,在 EvalPlus 和 GSM8K 中取得了最高分数。它在所有评估任务中显著超过了基于 MoE 的 Llama-4-Scout 基础模型的性能。

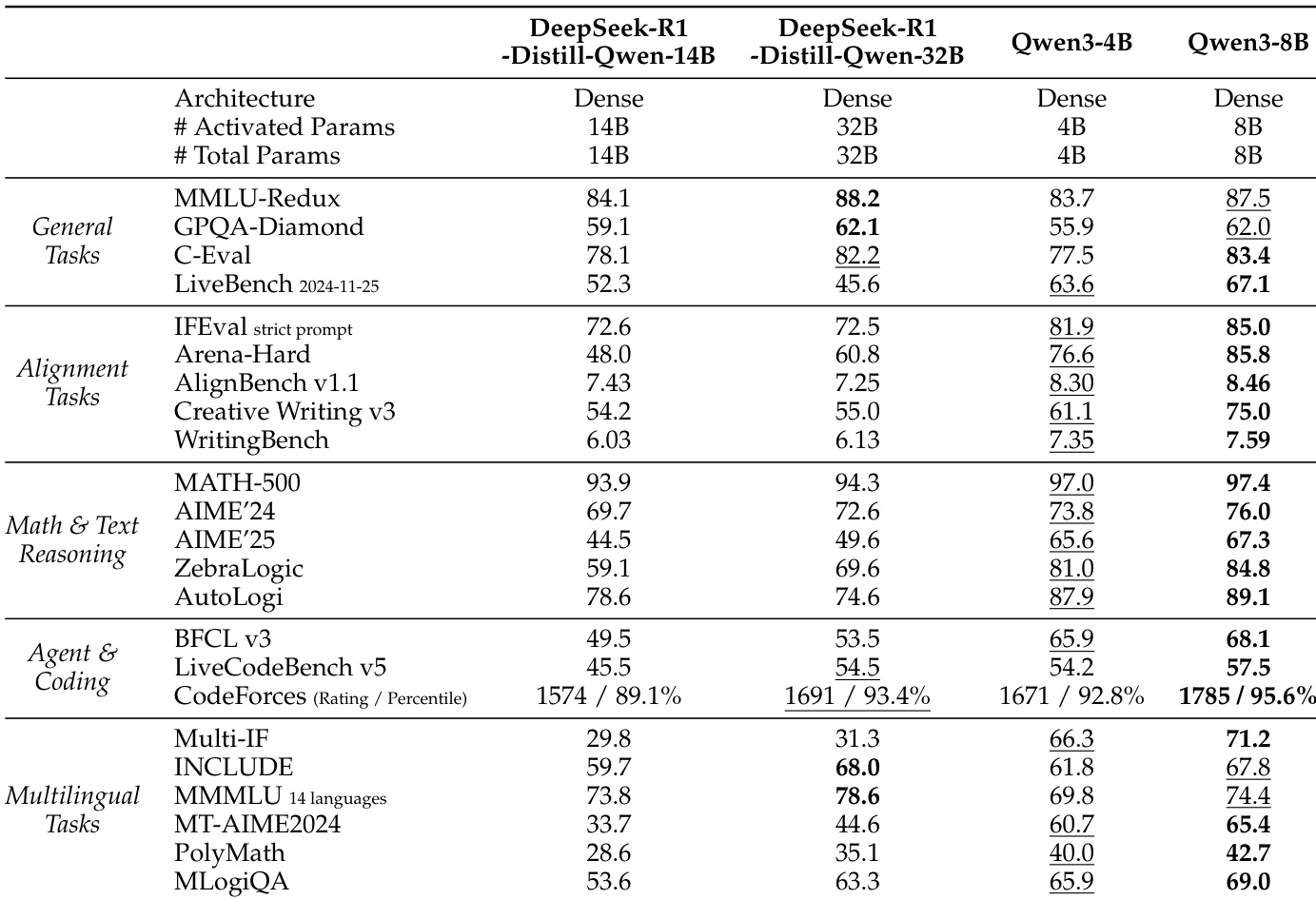

作者将 Qwen3-4B 和 Qwen3-8B 与思考模式下的 DeepSeek-R1 蒸馏模型进行了比较,发现较小的 Qwen3 模型在大多数基准测试中取得了更优越的性能。这证明了强到弱蒸馏方法在增强轻量级模型能力方面的有效性。Qwen3-8B 在通用和推理任务上的得分高于更大的 DeepSeek-R1-Distill-Qwen-32B。Qwen3-4B 在对齐和多语言基准测试中优于 DeepSeek-R1-Distill-Qwen-14B。在数学和代码任务中观察到 Qwen3 模型具有显著的性能优势。

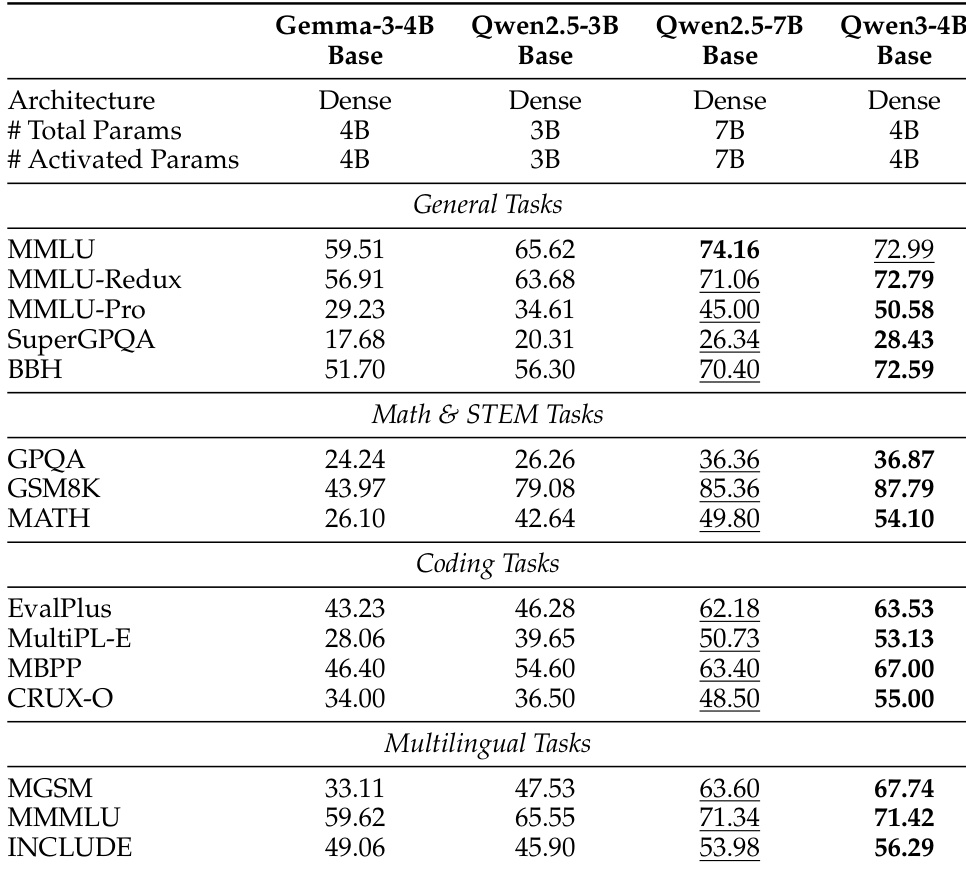

下表将 Qwen3-4B 基础模型与 Gemma-3-4B 和 Qwen2.5 系列模型在各种基准测试中进行了比较。结果表明,Qwen3-4B 模型达到了与更大的 Qwen2.5-7B 基础模型相当的性能水平,同时显著优于较小的 Qwen2.5-3B 基础模型。Qwen3-4B 匹配或超过了更大的 Qwen2.5-7B 模型的性能。该模型显示出比较小的 Qwen2.5-3B 变体实质性的改进。尽管尺寸较小,但在代码和 STEM 基准测试中仍取得了强劲的结果。

实验评估了 Qwen3 模型与强大基线(包括 Qwen2.5、Gemma-3 和 DeepSeek-R1)在多语言、数学和代码推理任务上的表现。激活思考模式始终能增强性能,而 Qwen3 系列展示了卓越的效率,尽管参数更少,但经常优于更大的一代前模型和蒸馏竞争对手。这些结果验证了强到弱蒸馏方法的有效性,并确认了相对于先前版本的重大架构进步。