Command Palette

Search for a command to run...

WorldPlay:迈向实时交互式世界建模的长期几何一致性

WorldPlay:迈向实时交互式世界建模的长期几何一致性

Wenqiang Sun Haiyu Zhang Haoyuan Wang Junta Wu Zehan Wang Zhenwei Wang Yunhong Wang Jun Zhang Tengfei Wang Chunchao Guo

摘要

本文提出WorldPlay,一种流式视频扩散模型,能够实现具有长期几何一致性的实时交互式世界建模,有效解决了当前方法在速度与内存之间的权衡难题。WorldPlay 的强大性能源于三项关键技术革新:1)采用双动作表示(Dual Action Representation),实现对用户键盘与鼠标输入的鲁棒动作控制;2)为保障长期一致性,提出重构上下文记忆(Reconstituted Context Memory),通过从历史帧中动态重建上下文,并利用时间重定位(temporal reframing)技术,使几何关键但时间久远的帧仍可被有效访问,从而显著缓解记忆衰减问题;3)提出一种新型知识蒸馏方法——上下文强制(Context Forcing),专为具备记忆感知能力的模型设计。该方法通过在教师模型与学生模型之间对齐记忆上下文,有效保留学生模型利用长程信息的能力,在实现实时推理速度的同时,抑制误差累积。综合上述技术,WorldPlay 可以以24帧/秒的速度生成长达时序的720p流式视频,展现出优异的几何一致性,在多种场景下均表现出卓越的泛化能力。项目主页与在线演示地址如下:https://3d-models.hunyuan.tencent.com/world/ 和 https://3d.hunyuan.tencent.com/sceneTo3D。

一句话总结

腾讯混元、香港科技大学与北京航空航天大学的研究人员提出WorldPlay,一种流式视频扩散模型,可实现实时交互式世界建模并保持长期几何一致性。该模型通过双重动作控制、动态上下文记忆重建及记忆感知蒸馏技术,克服了先前工作的记忆衰减问题,在真实与风格化环境中均能实现720p/24 FPS导航,且在场景重访时维持场景连贯性,适用于实际部署。

核心贡献

- WorldPlay通过引入双重动作表征解决实时交互式世界建模中的速度-记忆权衡问题,该表征支持精确的键盘与鼠标控制,消除动作歧义,确保流式视频生成过程中的可靠导航与记忆检索。

- 其重建上下文记忆机制动态重构历史帧上下文,并通过时间重映射保留几何关键的远期帧,有效缓解记忆衰减问题,保障跨多样场景的长期几何一致性。

- 创新的上下文强制蒸馏方法对齐师生模型间的记忆上下文以保留长距离信息,实现实时720p视频生成(24 FPS)且无误差漂移,在一致性基准测试中超越现有技术。

引言

作者针对虚拟环境、智能体训练及沉浸式模拟等应用中亟需的实时交互式世界模型展开研究——此类模型在用户长期导航中维持几何一致性至关重要,场景重访时的连贯性直接影响可用性。现有方法面临根本矛盾:显式3D重建方法虽能实现空间一致性,但重建误差会损害长期连贯性且缺乏实时性能;隐式视场条件技术虽可扩展,却无法在长期交互中保持几何精度。实时生成的蒸馏策略常因曝光偏差牺牲交互性或一致性。WorldPlay通过上下文强制蒸馏解决此问题,该技术在加速生成过程中保留历史场景几何信息,并结合记忆框架实现跨真实与风格化场景的实时导航与长期一致性。

数据集

作者采用WorldPlay数据集进行训练与评估,该数据集包含约32万段来自真实与合成源的高质量视频片段,关键细节如下:

-

数据集构成与来源:

数据集融合真实场景视频(经3D重建处理)与合成环境(游戏录屏及UE引擎渲染),分割为30-40秒片段,并附带文本与位姿标注。 -

子集详情:

- 真实世界动态场景(4万片段):源自Sekai [36],通过YOLO [51]过滤含密集人群、车辆、水印或剧烈运动的片段。

- 真实世界3D场景(6万片段):基于DL3DV [40];原始视频经3D高斯泼溅 [25] 重建,定制重访轨迹渲染,并通过Difix3D+ [66] 修复伪影。

- 合成3D场景(5万片段):由UE引擎场景生成,采用复杂定制相机轨迹。

- 模拟动态场景(17万片段):通过自定义游戏录屏平台采集,玩家生成1P/3P视角AAA级游戏画面并设计轨迹。

训练子集比例:真实世界动态场景12.5%、真实世界3D场景18.8%、合成3D场景15.6%、模拟动态场景53.1%。

-

数据使用与处理:

- 训练采用全部32万片段,比例同上。

- 视觉语言模型 [81] 生成文本标注;VIPE [20] 标注缺失相机位姿。

- 通过过滤相邻帧旋转/平移剧烈的片段缓解位姿坍塌。

- 离散动作通过轴投影与阈值化从连续位姿推导。

- 重访轨迹(图10重点标注)支持长期一致性学习。

-

评估设置:

基于DL3DV、游戏及AI图像构建600例测试集,通过循环轨迹评估短期质量(对比真值)与长期一致性。指标包含LPIPS、PSNR、SSIM及位姿距离得分。

方法

作者采用分块自回归扩散框架实现具备长期几何一致性的实时交互式世界建模。如框架图所示,核心架构通过预测下一视频块(含16帧)实现,该预测以用户动作、历史观测及初始场景描述(文本或图像)为条件。此过程迭代进行,每块生成均基于从历史帧动态重建的上下文记忆。

模型核心是自回归扩散Transformer,其因果式处理潜在视频标记。该Transformer集成两大创新:双重动作表征与重建上下文记忆。架构图详述的双重动作表征同时编码离散键盘输入与连续相机位姿:离散按键通过位置编码嵌入并融合至时间步调制路径;连续相机位姿则通过PROPE(投影相对位置编码)注入自注意力机制。此双重编码支持跨尺度场景的精确空间控制与稳定训练,其中相机位姿分量通过零初始化分支调制注意力以保持梯度稳定。

为维持长期一致性,模型采用重建上下文记忆模块动态构建新块的上下文集。该集合包含两部分:确保运动平滑的时间记忆(最近L个片段)与基于视场重叠度及相机距离采样几何相关历史帧的空间记忆。关键创新在于时间重映射技术——如记忆机制对比图所示,该技术重新分配检索帧的相对位置索引,将几何关键但时间遥远的记忆"拉近",确保其持续影响当前预测,缓解长序列漂移。

实时推理阶段,作者部署上下文强制——一种新型蒸馏策略,对齐双向教师模型与自回归学生模型的上下文记忆。学生模型基于重建记忆执行自 rollout,教师模型则增强相同上下文(排除目标块)。此对齐通过基于分数的损失实现有效分布匹配,即使在少步去噪下仍保持长期一致性。如上下文强制图所示,蒸馏管线采用记忆增强双向扩散计算真实与虚假分数,确保学生模型在相同记忆条件下复现教师行为。

最终,系统通过混合并行、渐进式VAE解码及量化优化流式部署。推理管线利用KV缓存避免自回归步骤中的冗余计算,实现720p分辨率24 FPS生成。记忆缓存随新帧持续更新,上下文重建按块执行,确保模型对用户输入实时响应的同时维持长期空间连贯性。

实验

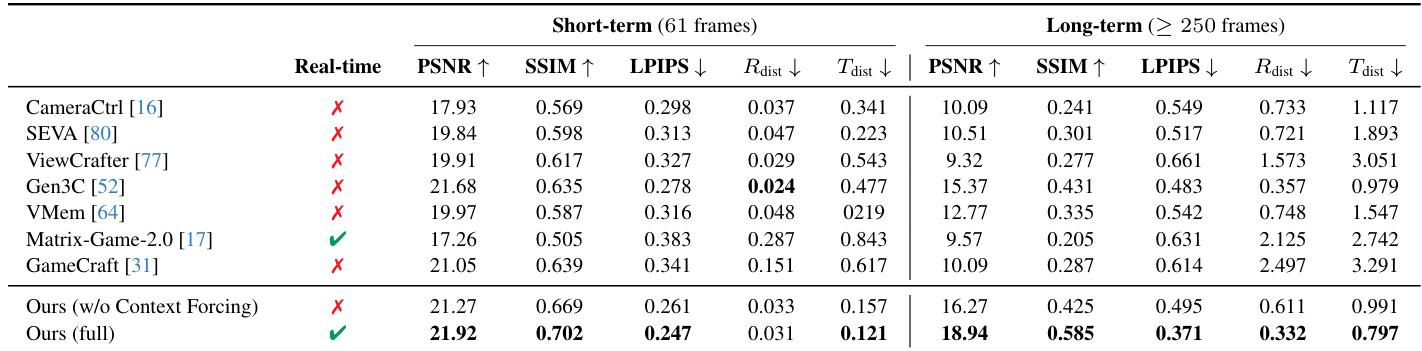

- 主实验在短期与长期交互式世界建模任务上验证WorldPlay,其在长序列场景中实现卓越视觉保真度与几何一致性,超越受深度精度限制的显式3D方法(Gen3C, VMem)

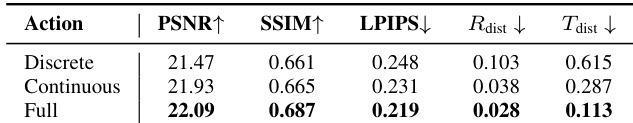

- 动作表征消融实验证实双重动作(离散按键+连续位姿)在Rdist与Tdist指标上提升控制精度,克服单表征方法局限

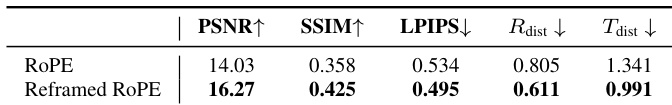

- RoPE设计对比表明重映射位置编码减少误差累积、增强长期一致性,在PSNR/SSIM等视觉指标上优于标准RoPE

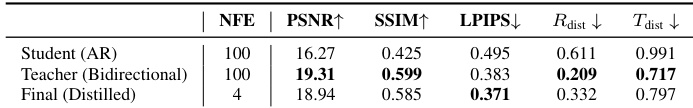

- 上下文强制评估显示对齐记忆蒸馏可防止输出坍塌与伪影,使学生模型在保持实时交互性的同时匹配教师级一致性

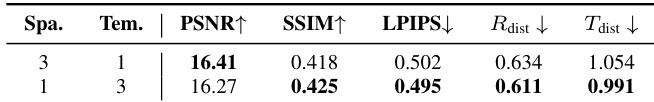

- 记忆规模消融揭示更大时间记忆提升整体性能,而过度空间记忆增加训练复杂度却无相应回报

- 600例VBench与人工评估证实WorldPlay在一致性、运动平滑度及场景泛化能力上表现优异,30名评估者一致偏好其视觉质量与控制精度

- 长视频生成在扩展序列中(如第1帧至第252帧)维持几何一致性,且每块生成时间恒定,支持实时交互

作者通过双重动作表征与上下文强制实现卓越的短期视觉保真度与长期几何一致性,在PSNR、SSIM及LPIPS指标上超越基线方法,同时保持实时交互性。结果表明:完整方法相比消融版本与先前工作显著降低长序列距离误差(Rdist与Tdist),尤其在长期稳定性与视觉质量上表现突出。

作者对比三种上下文强制模型,显示蒸馏后学生模型在视觉质量与控制精度间取得最佳平衡,且将推理步数降至4 NFE。结果表明:教师模型在PSNR与SSIM上占优但缺乏实时能力,而最终蒸馏模型除NFE外各项指标均优于学生模型。上下文强制使蒸馏模型以显著减少的函数评估次数维持长期一致性。

作者对比标准RoPE与所提重映射RoPE设计,显示重映射RoPE提升视觉质量与几何一致性。结果表明:PSNR与SSIM得分更高,LPIPS、Rdist及Tdist值更低,证实其减少误差累积并改善长期性能。

作者评估三种动作表征(离散、连续、双重(完整)),发现双重动作方法实现最佳整体控制性能:PSNR与SSIM最高,LPIPS最低,旋转与平移距离最小。连续动作虽优于离散动作,但双重表征进一步提升控制精度与视觉质量。结果证实:离散与连续信号结合可在动态场景中实现更精确稳定的智能体控制。

作者进行记忆规模消融实验,显示更大时间记忆(Tem. = 3)相比更大空间记忆(Spa. = 3)获得更高PSNR/SSIM,同时降低LPIPS、Rdist与Tdist。结果表明:时间记忆更有效保持预训练模型连续性及整体性能,尽管空间记忆带来轻微PSNR提升。